알리바바그룹(Alibaba Group)이 새 멀티모달 인공지능(AI) 모델을 출시해 통합형 AI 에이전트 사업 확장에 나섰다.

지난 3월 31일 알리바바클라우드(Alibaba Cloud)는 인공지농 모델인 ‘큐원’(Qwen) 시리즈의 통합 엔드투엔드 멀티모달 모델인 ‘큐원2.5-옴니-7B’(Qwen 2.5-Omni-7B)를 오픈소스로 공개했다고 밝혔다.

이 모델은 70억 파라미터로 구성된 경량형 모델이지만 성능 저하 없이 다양한 작업을 수행할 수 있다는 평가를 받고 있다.

‘큐원2.5-옴니-7B’는 실시간 음성 생성을 비롯한 명령어 이행, 영상 분석 등에서 산업별 AI 활용 사례를 확장할 수 있는 기반을 제공한다.

예를 들어 시각 장애인을 위한 음성 내비게이션, 영상 기반 요리 가이드, 지능형 고객응대 시스템 등에 적용 가능하다.

해당 모델은 텍스트 생성과 음성 합성을 분리한 ‘싱커-토커 아키텍처’와 모달 간 동기화를 위한 시간 정렬 멀티모달 로프 임베딩(TMRoPE), 저지연 스트리밍 응답을 위한 블록와이즈 처리 구조로 이뤄졌다.

모델은 ‘이미지-텍스트’, ‘영상-음성’, ‘음성-텍스트’ 등 여러 조합의 데이터셋 기반으로 사전학습돼 멀티모달 태스크가 가능하다.

알리바바클라우드는 이 모델이 텍스트 기반 성능에 근접하는 수준의 정밀도를 유지하면서도 다양한 모달을 통합해 해석할 수 있다고 주장했다.

또 상황 기반 음성 이해 능력을 강화한 인컨텍스트 러닝을 통해 자연스러운 응답 흐름을 구현했다.

강화학습 기반 최적화 과정에서 발음 오류, 음성 중단 등 문제를 최소화했다.

알리바바클라우드는 이 모델을 허깅페이스와 깃허브, 모델스코프 등에 공개했으며, 큐원챗(Qwen Chat)에도 모델을 통합한 상태다.

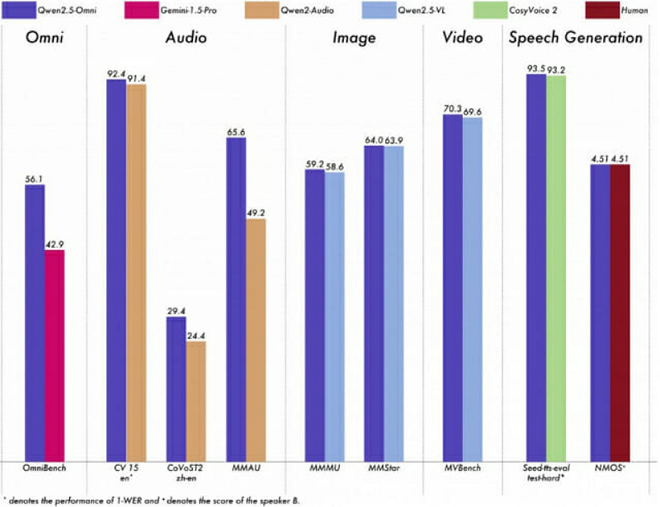

알리바바클라우드는 “큐원2.5-옴니는 단일 모달 모델과 비교해도 뒤처지지 않는 성능을 보인다.”며 “특히 윰니벤치 평가에서는 최고 수준의 결과를 기록했다.”고 강조했다.